L’Intelligence Artificielle fascine, impressionne, interroge. Elle rédige des textes, analyse des données, programme des algorithmes, crée des images et des vidéos, simule des conversations et même des interactions sociales. Elle donne parfois l’illusion d’une pensée autonome. Pourtant, comme l’a rappelé Jérôme Gastaldi lors du webinaire organisé par l’ECPI :

« L’IA ne pense pas le sens, elle exécute. »

Cette distinction est fondamentale : elle redéfinit la manière dont les professionnels et les entreprises peuvent exploiter l’IA et comprendre ses limites.

L’illusion de l’intelligence

Les modèles d’IA générative produisent des réponses cohérentes, structurées et souvent convaincantes. Ils semblent comprendre les intentions et anticiper les besoins. En réalité, ils ne font que calculer des probabilités à partir de gigantesques volumes de données, en choisissant le mot ou l’action la plus probable.

L’IA ne comprend pas le monde. Elle reproduit des structures statistiques apprises sur des données passées. Cette précision conceptuelle est essentielle pour sortir de l’imaginaire où la machine deviendrait un acteur autonome. L’Intelligence Artificielle reste un système mathématique sophistiqué, optimisé pour la prédiction et l’exécution, et non pour la réflexion ou le jugement.

De l’agentique à l’automatisation des décisions

Le webinaire a également abordé la montée en puissance des systèmes dits “agentiques”. Ces IA ne se contentent plus de répondre à des requêtes : elles exécutent des actions, enchaînent des tâches complexes et prennent des décisions opérationnelles dans un cadre défini.

Cette évolution offre des perspectives concrètes pour les entreprises :

- Automatisation avancée des processus : du traitement des factures à la gestion des stocks, les IA peuvent exécuter des workflows entiers sans intervention humaine.

- Optimisation des flux décisionnels : en analysant rapidement des scénarios multiples, elles soutiennent la prise de décision stratégique.

- Accélération des cycles d’analyse : elles permettent de traiter des volumes de données massifs en un temps record, identifiant tendances et anomalies.

Dans ce contexte, l’IA devient un véritable outil d’exécution stratégique, capable de multiplier la productivité et les capacités humaines tout en restant sous contrôle.

L’émergence de l’empathie artificielle

Autre phénomène marquant : la capacité des systèmes à simuler une forme d’empathie. Les modèles de langage peuvent adapter le ton d’une réponse, détecter l’émotion dans une requête et ajuster leur formulation pour rassurer, motiver ou persuader.

Cette “empathie artificielle” repose exclusivement sur des corrélations statistiques et l’analyse de données émotionnelles. Elle ne traduit aucune conscience ou ressenti émotionnel. Comme l’a souligné Jérôme Gastaldi : la machine peut imiter l’émotion, mais elle ne la ressent pas.

Cette distinction a des implications majeures dans des secteurs comme l’éducation, le management, le marketing ou la relation client, où la perception de l’émotion joue un rôle clé.

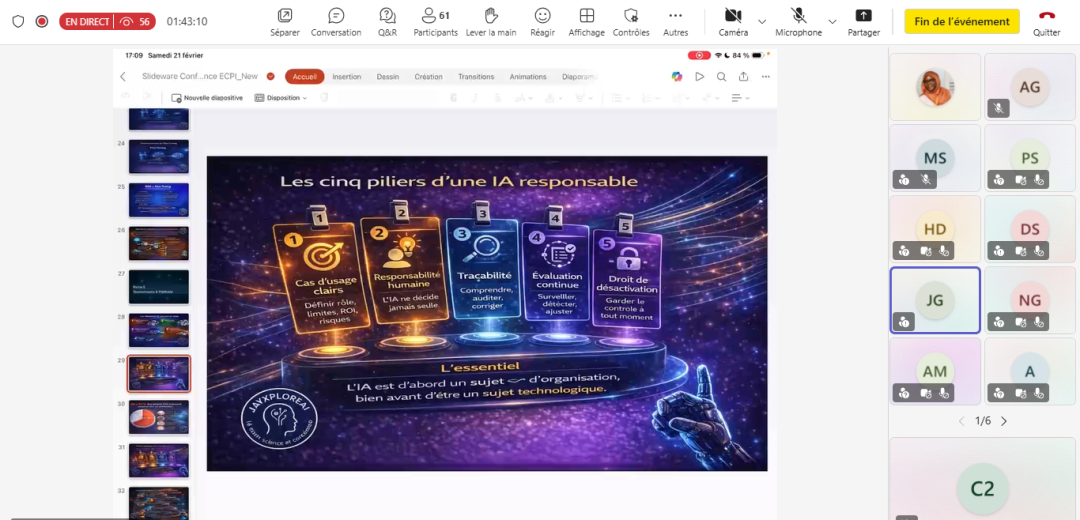

La responsabilité humaine au centre

La puissance de l’IA pose une question centrale : qui décide ? Qui valide ? Qui assume ? La technologie exécute, l’humain oriente.

Former des ingénieurs, des managers et des décideurs capables de comprendre les mécanismes techniques et les limites de l’IA devient une priorité stratégique. La maîtrise passe par la compréhension et la capacité à structurer une vision, définir un cadre et orienter l’usage.

À travers ce webinaire, l’ECPI rappelle que l’Intelligence Artificielle représente avant tout un outil d’amplification. Elle démultiplie la capacité d’action, elle optimise le temps et les ressources, mais elle ne remplace pas le discernement humain. L’enjeu réside dans l’art de combiner la puissance algorithmique et le jugement stratégique pour créer un impact réel et responsable.